Zentralisierte, dezentralisierte und verteilte Systeme: Kernunterschiede, Vorteile und Anwendungen

Die meisten Menschen denken nie darüber nach, was hinter dem Bildschirm passiert, wenn sie eine Taste auf ihrem Handy drücken. Doch die Architektur, die alles zusammenhält, bestimmt unser digitales Leben – von der Sicherheit unserer Ersparnisse bis zur Ladegeschwindigkeit einer Webseite. Ich finde oft, dass die Wahl zwischen zentralisierten und verteilten Modellen mehr ist als eine trockene technische Debatte. Es ist eine grundlegende Entscheidung über Macht, Vertrauen und die Frage, wer eigentlich unsere Daten besitzt. In diesem Leitfaden werden wir aufschlüsseln, wie diese Systeme funktionieren und warum die falsche Wahl für jedes Projekt fatal sein kann.

Überblick über zentralisierte, dezentralisierte und verteilte Systeme

Bevor wir uns in den technischen Details verlieren, werfen wir einen Blick auf das große Ganze. Meist werfen wir diese Begriffe in einen Topf, aber es sind sehr unterschiedliche Werkzeuge für sehr unterschiedliche Aufgaben. Denken Sie an den Unterschied zwischen einem Königreich mit einem einzigen Monarchen und einem Netzwerk unabhängiger Dörfer. In der Tech-Welt läuft es ganz ähnlich. Ein zentralisiertes System verlässt sich auf ein einziges „Gehirn“, ein dezentralisiertes teilt die Autorität auf, und ein verteiltes System zwingt viele Maschinen dazu, als eine Einheit zu agieren. Es gibt hier kein „perfektes“ System – nur das Modell, das am besten zu dem passt, was man bauen möchte.

Zentralisierte Systeme

Denken Sie an Ihr klassisches Bankkonto. Jede einzelne Transaktion läuft über einen zentralen Server, der der Bank gehört. Das ist ein klassisches zentralisiertes System. Es gibt einen Besitzer und einen Kontrollpunkt. Die Verwaltung ist einfach, da es nur eine einzige Quelle der Wahrheit gibt. Diese Einfachheit hat jedoch einen gewaltigen Haken: Wenn dieser zentrale Server ausfällt oder gehackt wird, steht alles still. Mir war es schon immer etwas unheimlich, wie sehr unsere digitale Existenz an diesen einzelnen Fäden hängt, auch wenn sie die meiste Zeit über sehr schnell und effizient funktionieren.

Dezentralisierte Systeme

Hier ändern sich die Spielregeln. In einem dezentralen Aufbau gibt es keinen „großen Boss“. Innerhalb des Netzwerks kommunizieren die Knoten direkt miteinander und bewahren dabei ihre Unabhängigkeit. Die Blockchain ist hier das Paradebeispiel – Bitcoin braucht keine Zentrale, um eine Zahlung zu verifizieren. Solch eine Menge unabhängiger Akteure zu koordinieren, stellt jedoch eine echte Herausforderung dar und macht die Dinge oft langsamer. Aber die Idee eines Systems, das niemand einfach per Knopfdruck „abschalten“ kann, empfinde ich in der heutigen Zeit als unglaublich widerstandsfähig und notwendig.

Verteilte Systeme

Verteilte Systeme werden oft mit dezentralen verwechselt, aber ihr Ziel ist kollektive Leistung statt geteilter Macht. Hier arbeiten viele Computer zusammen, um eine gewaltige Aufgabe zu bewältigen. Die Cloud von Google oder die Datenbanken globaler Konzerne funktionieren genau so. Sie verteilen die Arbeitslast so effektiv, dass man es gar nicht merkt, wenn am anderen Ende des Planeten plötzlich ein paar Server ausfallen. Es geht rein um Skalierung. Ich habe erlebt, wie diese Systeme Terabytes an Daten verarbeiten, ohne ins Schwitzen zu geraten, was ehrlich gesagt eine beachtliche Leistung ist.

Historischer Kontext der Systemmodelle

Ein Blick zurück auf unsere Anfänge hilft zu verstehen, warum heute alle so besessen von der Blockchain sind. In den 1960er Jahren war alles extrem geradlinig und, um ehrlich zu sein, ein bisschen langweilig. Massive Mainframes (die Hauptrechner) füllten ganze Räume aus und fungierten als einziges „Gehirn“ für den gesamten Betrieb. Wenn diese Maschine aufgab, konnten alle anderen nicht mehr arbeiten. Es erinnert mich an alte Fabriken, in denen alles von einem einzigen Generator abhing. Es war eine Ära absoluter Zentralisierung, in der wir Skalierbarkeit und Resilienz gegen einfache Kontrolle eintauschten.

Die Regeln des digitalen Spiels haben sich über die Jahrzehnte stark verschoben:

- 1960er — Die Mainframe-Ära. Totale Abhängigkeit von einem Zentrum. Leicht zu verwalten für den Besitzer, aber ein enormes Ausfallrisiko für alle anderen.

- 1980er — Ein Hauch von Freiheit. P2P-Netzwerke entstanden. Die Leute merkten, dass sie Daten direkt austauschen konnten, ohne einen zentralen Server um Erlaubnis zu fragen.

- 1990er — Die Internet-Explosion. Das World Wide Web zwang uns, Wege zu finden, Millionen von Geräten zu verknüpfen. Ein einziger Kontrollpunkt konnte die globale Nachfrage physisch nicht mehr bewältigen.

- 2000er — Der Cloud-Boom. Verteilte Datenbanken und Dienste wie Google Cloud kamen auf. Wir lernten, Systeme zu bauen, denen der Ausfall einzelner Knoten egal war.

- 2010er — Das Blockchain-Zeitalter. Wir kehrten zur Dezentralisierung zurück, aber mit einem ernsthaften Technik-Upgrade, das auf Ehrlichkeit, Sicherheit und Transparenz setzt.

Ich finde diese ganze Entwicklung ziemlich ironisch. Wir begannen mit einem großen Computer, verbrachten Jahre damit, alle zu vernetzen, und arbeiten nun hart daran, dass niemand das Netzwerk allein besitzen kann. Jedes Jahrzehnt löste ein spezifisches Problem. Zuerst mussten die Dinge einfach funktionieren. Dann mussten sie wachsen. Jetzt wollen wir Vertrauen ohne Mittelsmann. Dieser Zeitstrahl handelt nicht nur von Hardware; es ist die Geschichte unseres Versuchs, gleichzeitig mächtig und unabhängig zu sein.

Vergleich von zentralisierten, dezentralisierten und verteilten Systemen

Als ich anfing, mich mit Architekturen zu beschäftigen, dachte ich, es wäre wie die Wahl einer Farbpalette. Aber die Wahl eines Systems ähnelt eher dem Fundament eines Hauses. Wenn man es falsch macht, bekommt das gesamte Gebäude irgendwann Risse. Die Hauptfrage ist nicht, welche Tech „cooler“ ist. Es geht darum, was einem am wichtigsten ist. Ist es Geschwindigkeit? Ist es Sicherheit? Oder vielleicht totale Kontrolle? Diese Nuancen zu verstehen hilft dabei, Trends nicht nur blind zu folgen, sondern das richtige Werkzeug für das eigene Unternehmen oder Projekt zu wählen.

Die wichtigsten Unterschiede

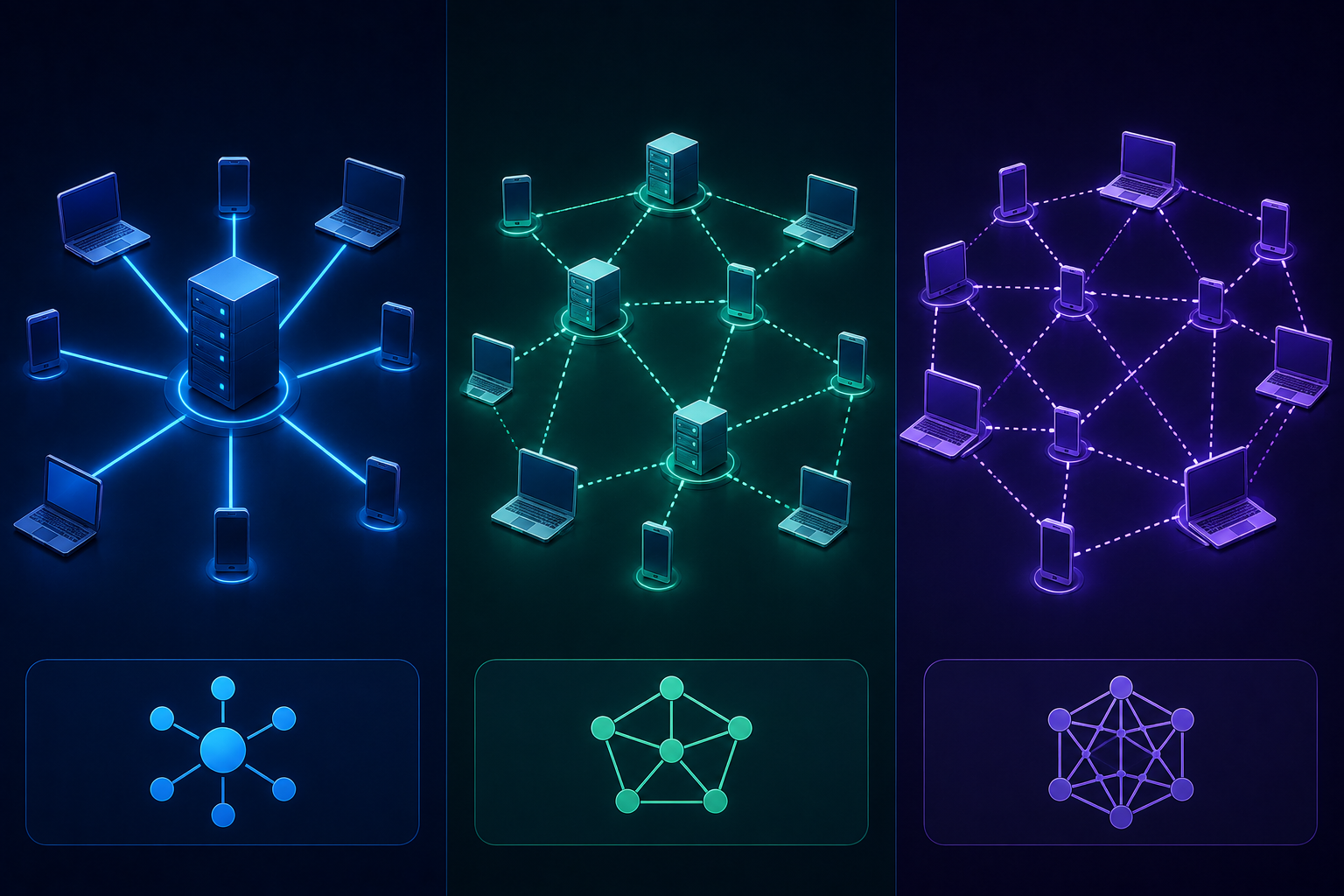

Der Kernunterschied zwischen diesen drei Ansätzen liegt in der Verwaltung und der Ausfallsicherheit. Zentralisierte Systeme stehen für Ordnung und Einfachheit. Ein Hauptserver gibt den Ton an. Das ist praktisch, solange die Last gering ist, aber das System erstickt, sobald der Datenverkehr sprunghaft ansteigt. Dezentralisierte Systeme hingegen teilen sich die Macht. Jeder Knoten ist sein eigener Chef, was das Netzwerk fast unzerstörbar, aber wahnsinnig schwer zu verwalten macht. Verteilte Systeme sind eine andere Klasse: Ihre Knoten arbeiten als enges Team für maximale Gemeinschaftsleistung. Das ist die beste Wahl, wenn man massive Skalierung und Schutz vor zufälligen Fehlern benötigt.

Visueller Vergleich

Wenn man sich das bildlich vorstellt, sind die Diagramme sehr aussagekräftig. Ein zentralisiertes Modell sieht aus wie ein Stern, bei dem jeder Strahl auf einen Punkt in der Mitte zeigt. Entfernt man diesen Punkt, bricht alles zusammen. Eine dezentrale Karte ähnelt eher einer Gruppe von Sternbildern – verbunden, aber ohne eine einzige Sonne. Ein verteiltes System hingegen ist wie ein riesiges Netz, in dem jeder Knoten mit anderen verflochten ist. Es gibt keinen „Anführer“ im klassischen Sinne, aber Daten können gleichzeitig über Dutzende verschiedene Pfade reisen.

Abwägungen und Kompromisse

In der Technik gibt es nichts geschenkt. Wenn man sich für eine Seite entscheidet, verliert man zwangsläufig etwas anderes. Zentralisierte Systeme zeigen anfangs oft eine enorme Geschwindigkeit und sind günstiger im Unterhalt, können aber später aufgrund von Sicherheitsrisiken zum Millionengrab werden. Dezentralisierung erfordert früh hohe Investitionen in Koordination und Sicherheit, erweist sich aber über die Zeit oft als kosteneffizienter und stabiler. Verteilte Systeme fungieren als „goldene Mitte“, in der Ressourcen so effizient wie möglich genutzt werden, um Wartungskosten und Gesamtleistung in Einklang zu bringen.

Anwendungen der einzelnen Systemtypen

Theorie ist das eine, aber ich fand es schon immer spannender zu sehen, wie diese Designs „in freier Wildbahn“ funktionieren. Wir interagieren täglich mit allen drei Systemtypen, ohne es zu merken. Egal, ob Sie einen Kaffee bezahlen, durch soziale Medien scrollen oder ein Foto in die Cloud hochladen – Sie lösen unterschiedliche architektonische Entscheidungen aus. Jede wurde aus einem bestimmten Grund gewählt. Entwickler versuchen ständig, den optimalen Punkt zwischen einfacher Verwaltung und tatsächlicher Wachstumsgeschwindigkeit zu finden.

Zentralisierte Systeme im Alltag

Das traditionelle Bankwesen ist hier wohl das klarste Beispiel. Wenn Sie Geld an einen Freund senden, fungiert die Bank als jenes „Zentrum“, das bestätigt, dass Sie das Geld auch wirklich haben. Das ist praktisch, weil eine einzige Organisation für alles verantwortlich ist. Das Gleiche sehen wir bei Social-Media-Plattformen wie Facebook oder Instagram. Sie haben die totale Kontrolle über Ihre Daten und das, was in Ihrem Feed erscheint. Ich verstehe, warum Konzerne diesen Weg wählen – es macht es viel einfacher, Updates einzuspielen und die Sicherheit zu gewährleisten, auch wenn wir dadurch von einem einzigen Akteur abhängig sind.

Wie dezentrale Systeme Blockchain und Kryptowährungen antreiben

Hier drehen sich die Spielregeln komplett um. Bitcoin war das erste große Statement dafür, dass wir keine Mittelsmänner brauchen, um Werte auszutauschen. Es gibt in diesem Netzwerk keine Zentrale, bei der man sich beschweren könnte, und doch läuft es wie am Schnürchen. Ethereum ging mit „Smart Contracts“, die Deals automatisch ausführen, noch einen Schritt weiter. Um diese Netzwerke zu unterstützen und dabei Profit zu machen, nutzen viele spezialisierte Hardware wie ASIC-Miner. Ich denke, genau dort liegt die wahre Freiheit – wenn die Regeln durch transparenten Code und nicht durch Bürokraten hinter verschlossenen Türen festgelegt werden.

Verteilte Systeme im Cloud Computing und darüber hinaus

Wenn wir über massive Skalierung sprechen, betreten verteilte Systeme die Bühne. Cloud-Computing-Plattformen wie Google Cloud funktionieren genau so: Tausende von Servern weltweit vernetzen sich, damit Sie eine schwere Datei in Sekundenbruchteilen öffnen können. In der Welt von Big Data helfen Tools wie Hadoop Unternehmen dabei, gigantische Infomengen zu bewältigen. Ich erinnere mich an eine Fallstudie über eine Firma namens Unternehmen X, die auf ein verteiltes Cloud-Modell umstellte. Sie wurden nicht nur schneller; sie konnten die Kosten signifikant senken. Es ist die Standardlösung für jeden, der grenzenlos skalieren und einen Totalausfall zum denkbar schlechtesten Zeitpunkt vermeiden muss.

Die Zukunft der Systemarchitekturen

Wenn ich mir vorstelle, wohin uns diese Technologien führen, habe ich gemischte Gefühle. Einerseits bewegen wir uns klar auf eine Welt zu, in der niemand einfach nach Lust und Laune Ihre Wallet „abschalten“ oder Ihren Zugang zu Informationen blockieren kann. Andererseits wird die Verwaltung dieser verstreuten Realität unglaublich kompliziert. Die Zukunft der Architektur dreht sich nicht nur um schnellere Server. Es geht darum, einen Weg zu finden, Milliarden von Geräten zur Zusammenarbeit zu bewegen, ohne alles in ein digitales Chaos zu verwandeln. Ich habe das Gefühl, wir stehen an einem Punkt, an dem Technologie aufhört, nur ein Werkzeug zu sein, und beginnt, das Fundament eines neuen Gesellschaftsvertrags zu werden.

Trends in der Dezentralisierung

Es gibt gerade viel Wirbel um DeFi (dezentrale Finanzen), aber ich denke, das ist erst der Anfang eines massiven Umbaus. Wir sehen, wie diese Ideen in Lieferketten und die Verifizierung digitaler Identitäten einfließen. Stellen Sie sich vor, Sie müssten sich nicht mehr vor irgendeinem Beamten ausweisen, weil Ihre digitale Signatur bereits von tausenden unabhängigen Knoten in einem Netzwerk bestätigt wurde. Das klingt wie aus einem Cyberpunk-Roman, aber es ist der Pfad, auf dem wir uns befinden. Die größte Hürde wird die Regulierung sein. Behörden wissen immer noch nicht, wie sie mit Systemen umgehen sollen, die kein Hauptquartier und keinen CEO haben, den man anrufen kann.

Verteilte Systeme in KI und IoT

Dann ist da noch das IoT (Internet der Dinge). Experten schätzen, dass es bis 2025 über 75 Milliarden vernetzte Geräte geben wird. Diese Zahl ist ehrlich gesagt schwer zu begreifen. Jeder einzelne Sensor muss Daten austauschen, und ein zentraler Server würde unter diesem Druck einfach ersticken. Deshalb werden verteilte Systeme so beliebt – sie verarbeiten Informationen genau dort, wo sie entstehen. Wenn man dann noch KI (Künstliche Intelligenz) ins Spiel bringt, wird es erst richtig wild. Verteilte neuronale Netze könnten viel schneller lernen, indem sie die ungenutzte Leistung von Millionen kleiner Geräte nutzen, anstatt sich nur auf massive Serverfarmen der Tech-Giganten zu verlassen.

Fazit

Ich erwische mich oft bei dem Gedanken, dass die Debatte über Architekturen mehr ist als nur trockener Tech-Talk. Es ist ein Gespräch darüber, wie wir online miteinander umgehen wollen und wem wir unsere Informationen anvertrauen. Zentralisierte Systeme brachten uns die Stabilität, an die wir gewöhnt sind, Dezentralisierung gab uns eine Chance auf echte Transparenz, und verteilte Netzwerke gaben uns die Werkzeuge für massive Datenmengen. Wir wählen nicht mehr nur ein Modell für jede Aufgabe; wir bauen eine komplexe, hybride Realität.

Erwarten Sie nicht, dass die ganze Welt über Nacht dezentral wird. Das wird nicht passieren, und um ehrlich zu sein, brauchen wir das auch nicht. Viel wichtiger ist es zu lernen, wie man die Vorteile verschiedener Ansätze mischt: die Geschwindigkeit der Cloud, die Sicherheit der Blockchain und die einfache Bequemlichkeit von Old-School-Banking. Mein persönliches Fazit nach der Betrachtung all dieser Modelle ist simpel: Das beste System ist dasjenige, das Ihr spezifisches Problem genau hier und jetzt löst. Technik bewegt sich schnell, und unser Job ist es nicht nur, Trends zu folgen, sondern zu verstehen, was wir für all diese Effizienz eigentlich eintauschen.